Berny Céspedes Oviedo

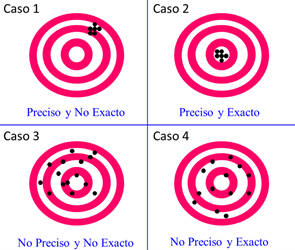

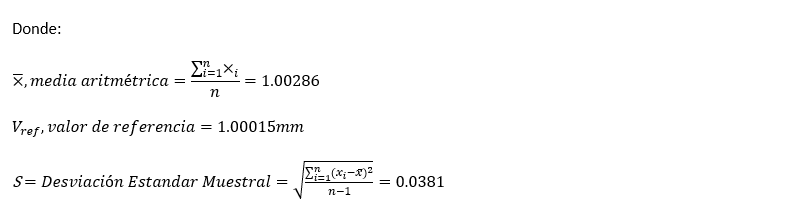

La exactitud y la precisión, dos conceptos muy discutidos y que llevan a confusión cuando se utilizan como sinónimos, pero si bien es sabido por muchos que la exactitud nos indica la cercanía con un valor “verdadero” en una medición, mientras que la precisión representa a la variación de los datos al repetir esa medición, resulta que estos dos conceptos se encuentran más relacionados de lo que pudiéramos pensar. Por lo que la frase que utilizo como título para este artículo me ha generado más de una discusión, ¡y cómo no!, si la primera imagen que se viene a la mente cuando digo esto, es el clásico del juego de dardos con el que típicamente se explican estos dos conceptos como se puede observar en la figura 1 y en donde aparece el caso número 4, en el que no hay precisión, pero si exactitud.

Figura 1

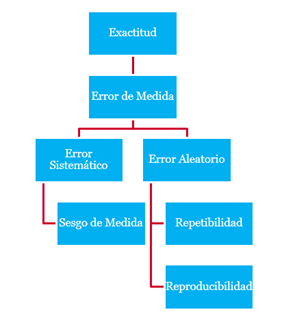

La primera vez que me planteé esto fue en año 2006, cuando comenzaba a trabajar como técnico de calibraciones. Recuerdo que nos habíamos cuestionado una situación específica que se podía presentar cuando se realizaban las calibraciones. Por ejemplo, un Vernier Digital de 0 a 150mm de rango, se calibraba con una tolerancia de +/- 0.02mm en 5 puntos a lo largo de su rango de indicación, el primero a 1mm, el segundo a 20mm, etc.… hasta cubrir toda la longitud de medición del Vernier, en cada punto se medía 7 veces y se registraba él promedio de este como resultado de calibración.

El punto de la discusión era que, si dentro de las 7 mediciones realizadas en cualquiera de los puntos de calibración se encontraban datos fuera de la tolerancia de calibración en los extremos contrarios de esta y al calcular el promedio este resultaba dentro de tolerancia. ¿Qué debemos hacer con el Vernier? ¿Devolverlo al dueño porque pasó la calibración ya que es exacto según el caso 4 de la figura 1? o ¿Fallar la calibración porque no es preciso ya que tiene mediciones individuales fuera de la tolerancia?

A continuación, un ejemplo del problema planteado con los datos para el punto de calibración de 1mm.

Pero comencemos por explicar la exactitud, la precisión, sus componentes y su relación con otros conceptos,

La Exactitud, es la cercanía entre un valor medido y un valor verdadero de un mensurando, no es una magnitud y no se expresa numéricamente ya que es un término cualitativo e incluye los conceptos también cualitativos de veracidad de medida y precisión. Si queremos cuantificar la exactitud de medida, debemos calcular el error de medida ya que entre menor sea este la medición es más exacta.

La Veracidad de Medida, es la proximidad entre la media de un número infinito de valores medidos repetidos y un valor de referencia. Se estima mediante el inversamente relacionado concepto de sesgo de medida, también conocido como error sistemático.

La Precisión, es la proximidad entre las indicaciones o los valores medidos obtenidos en mediciones repetidas de un mismo objeto, o de objetos similares, bajo condiciones especificadas. La precisión se utiliza para la definición de los errores aleatorios como la repetibilidad de medida, la precisión intermedia y la reproducibilidad. Para cuantificarla debemos hacer uso de medidas de variación como la desviación estándar, varianza, rango y coeficiente de variación.

Ahora sí, retomemos mis inquietudes de cuando comenzaba a trabajar como técnico de calibración. Apoyándonos en la figura 1, y utilizando el procedimiento de evaluación mencionado, estaríamos intentando calcular el error de medida para cuantificar la exactitud con la siguiente fórmula,

Pero con el repaso conceptual que acabamos de hacer, es evidente que estamos cayendo en la equivocación de no incluir a la precisión dentro del cálculo de error de medida por lo que solo estaremos calculando el sesgo de medida.

Hasta acá, todavía no sabemos qué hacer con el Vernier y surge una pregunta más…

¿LA EXACTITUD SE PUEDE CALCULAR INCLUYENDO A LA PRECISION?

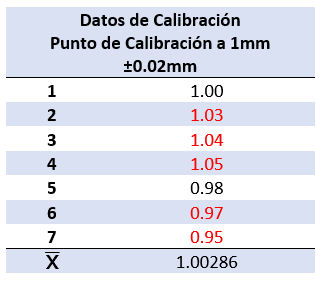

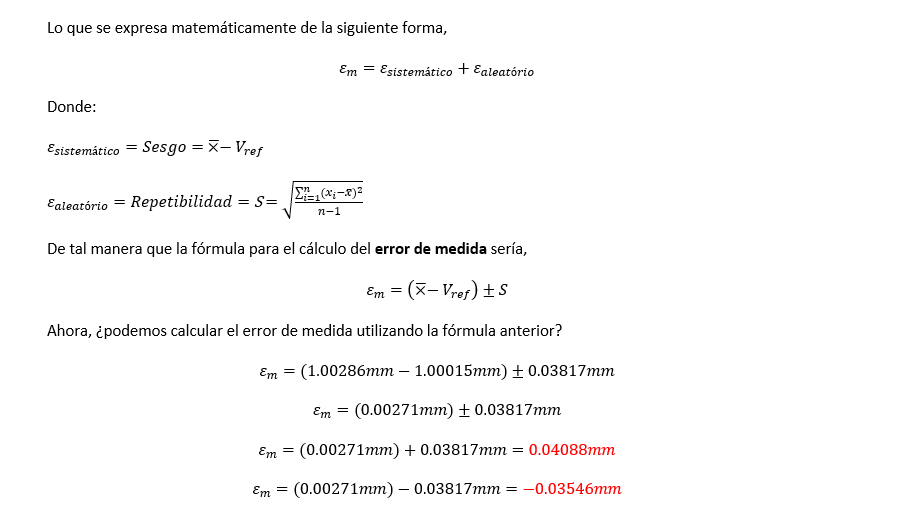

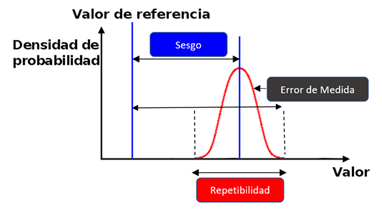

Por supuesto que sí, y lo desarrollaremos de manera progresiva. Como ya vimos, el error de medida posee dos componentes, el error sistemático (sesgo de medida) y el error aleatorio (precisión), esta relación la podemos observar en la figura 2.

Figura 2

Obtuvimos 2 resultados 0.04088mm y -0.03546mm, esto indica que el error de medida se encontrará dentro de un intervalo de dispersión, cuyos valores extremos son los 2 resultados obtenidos. Conceptualmente se puede representar mediante la figura 3.

Figura 3

Nuestro cálculo si bien nos ofrece una respuesta para tomar una decisión sobre el Vernier, se encuentra incompleto debido a que desde un punto de vista teórico y práctico el error de medida calculado no tiene mayor validez sin la existencia de un nivel de confianza para el intervalo estimado.

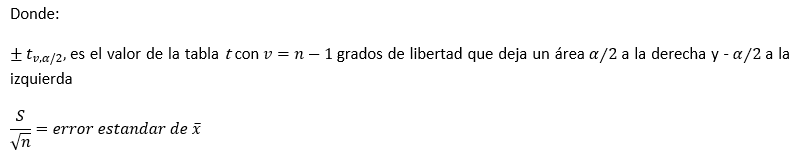

Para afinar un poco más el cálculo del error de medida con el que hemos estado trabajando, nos apoyaremos en el Teorema del Límite Central, trabaremos sobre el supuesto de la normalidad de los datos para estandarizar la desviación estándar y transformarla en el error estándar de , con una distribución t a un nivel de confianza del 95% para el intervalo de dispersión estimado,

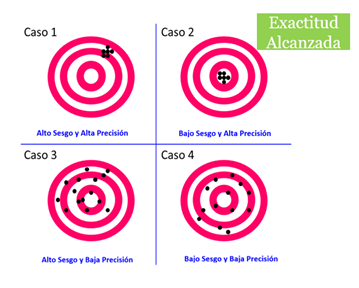

De esta manera, utilizando el error sistemático y el error aleatorio para obtener el error de medida a un nivel de confianza acordado (95%), se comprueba si la exactitud es alcanzada para una tolerancia establecida de +/- 0.02mm.

En efecto el Vernier falla la calibración, ya que el intervalo de dispersión atribuido al error de media con un 95% de confianza excede los límites de la tolerancia, con lo cual no podemos afirmar si el Vernier cumple o no con la especificación establecida, como se puede observar en la figura 4.

Figura 4

Ahora, mediante la figura 5 podremos entender mejor la manera de conceptualizar si la exactitud es lograda o no, ya que para esto el sesgo y la repetibilidad deben ser aceptables y cambiar la famosa frase, “es exacto, pero no preciso” por “el sesgo es aceptable pero la precisión no” por lo que la exactitud requerida no es alcanzada.

Figura 5

El procedimiento que he desarrollado puede utilizarse para determinar si la exactitud es alcanzada o no, en mediciones para inspecciones en proceso o producto terminado.

Es importante aclarar que la definición de calibración incluyó el concepto de incertidumbre hasta la versión del año 2008 del VIM, por lo que antes de esa versión muchos de los laboratorios de calibración a nivel de la industria no calculaban incertidumbres en sus procesos de calibración.

Para las personas que trabajan en el campo de la metrología en la actualidad, la forma de verificar si la exactitud es lograda se realiza mediante el proceso de confirmación metrológica (ISO 10012), donde se contempla la calibración y verificación de los equipos. En este caso la caracterización del error de medida también incluye el error sistemático que se determina mediante el sesgo de medida y el error aleatorio a través del cálculo de la incertidumbre de medida, es importante destacar que el concepto de incertidumbre es mucho más amplio que el de precisión, puesto que este incluye además de los factores aleatorios, factores sistemáticos provenientes de correcciones efectuadas a la medición.

Siempre que existan límites de especificación, nos veremos obligados a determinar si nuestros procesos son lo suficientemente exactos o capaces, pero hay que tener presente que la exactitud está en dependencia de la precisión.

Referencias

JCGM 200:2008, Vocabulario Internacional de Metrología ⎯ Conceptos fundamentales y generales, y términos asociados (VIM), (1ª Edición en español, 2008).

Churchill Eisenhart, “Realistic Evaluation of the Precision and Accuracy of Instrument Calibration Systems” in the Journal of Research of the National Bureau of Standards, 1963.

INTE/ISO 10012, Sistema de Gestión de las Mediciones, 2003.

Measurement Systems Analysis (MSA), 4th Edition, 2010. Automotive Industrial Action Group (AIAG).

Guía para la Expresión de la Incertidumbre de Mediciones (GUM), 1995.

ISO 5725-1, Accuracy (trueness and precision) of measurement methods and results – Part 1: General principles and definitions, 1st ed., 1994.

Probability and Statistics for Engineer and Scientist, 9th Edition 2014. Ronald Walpole, Raymond Myers, Sharon Myers and Keying Te.